иҝ‘жңҹпјҢдҝЎжҒҜеӯҰйҷўйҷҲеҝ—жіҠж•ҷжҺҲиҜҫйўҳз»„еңЁй«ҳеҲҶиҫЁзҺҮйҒҘж„ҹеӣҫеғҸеҸҳеҢ–жЈҖжөӢз ”з©¶ж–№йқўеҸ–еҫ—з ”з©¶иҝӣеұ•пјҢз ”з©¶жҲҗжһңд»ҘвҖңA CNN-Transformer Network Combining CBAM for Change Detection in High-Resolution Remote Sensing ImagesвҖқдёәйўҳпјҢеңЁйҒҘж„ҹйўҶеҹҹTOPжңҹеҲҠгҖҠRemote SensingгҖӢпјҲдәҢеҢәTOPпјҢIF="5.349пјүдёҠеҸ‘иЎЁгҖӮ

йҒҘж„ҹеӣҫеғҸеҸҳеҢ–жЈҖжөӢжҳҜжҢҮд»ҺеҗҢдёҖеҢәеҹҹдёҚеҗҢж—¶й—ҙиҺ·еҸ–зҡ„еӨҡе№…йҒҘж„ҹеӣҫеғҸдёӯжҸҗеҸ–еҸҳеҢ–еҢәеҹҹзҡ„иҝҮзЁӢпјҢиҝҷеҜ№дәҺеҝ«йҖҹжЈҖжөӢе’ҢеҮҶзЎ®дәҶи§Јең°иЎЁеҸҳеҢ–е…·жңүйҮҚиҰҒзҡ„ж„Ҹд№үгҖӮйҡҸзқҖйҒҘж„ҹжҠҖжңҜзҡ„еҸ‘еұ•пјҢйҒҘж„ҹеӣҫеғҸзҡ„з©әй—ҙеҲҶиҫЁзҺҮи¶ҠжқҘи¶Ҡй«ҳпјҢеӣҫеғҸдёӯеҢ…еҗ«зҡ„ең°зү©з»ҶиҠӮдҝЎжҒҜд№ҹи¶ҠжқҘи¶ҠеӨҡпјҢе…·жңүзӣёеҗҢиҜӯд№үжҰӮеҝөзҡ„зү©дҪ“еңЁдёҚеҗҢж—¶й—ҙгҖҒдёҚеҗҢз©әй—ҙдҪҚзҪ®дјҡиЎЁзҺ°еҮәдёҚеҗҢзҡ„е…үи°ұзү№еҫҒгҖӮеӣ жӯӨпјҢдј з»ҹзҡ„еҸҳеҢ–жЈҖжөӢжүӢж®өпјҢеҰӮеҹәдәҺеғҸзҙ зҡ„еҸҳеҢ–жЈҖжөӢе’ҢеҹәдәҺеҜ№иұЎзҡ„еҸҳеҢ–жЈҖжөӢпјҢйғҪдёҚеҶҚйҖӮз”ЁдәҺй«ҳеҲҶиҫЁзҺҮйҒҘж„ҹеӣҫеғҸеҸҳеҢ–жЈҖжөӢгҖӮ

зӣ®еүҚеҹәдәҺж·ұеәҰеӯҰд№ зҡ„еҸҳеҢ–жЈҖжөӢж–№жі•еӨ§еӨҡйҖҡиҝҮеңЁдј з»ҹеҚ·з§ҜзҪ‘з»ңдёӯеј•е…ҘжіЁж„ҸеҠӣжңәеҲ¶жқҘз”ҹжҲҗжЈҖжөӢз»“жһңгҖӮ然иҖҢпјҢз”ұдәҺж„ҹеҸ—йҮҺзҡ„йҷҗеҲ¶пјҢеҹәдәҺеҚ·з§Ҝзҡ„ж–№жі•ж— жі•е……еҲҶе»әжЁЎе…ЁеұҖдёҠдёӢж–Үе’ҢжҚ•жҚүй•ҝзЁӢдҫқиө–е…ізі»пјҢеӣ жӯӨпјҢеңЁеҢәеҲҶдјӘеҸҳеҢ–ж–№йқўеӯҳеңЁдёҚи¶ігҖӮTransformerе…·жңүй«ҳж•Ҳзҡ„е…ЁеұҖж—¶з©әе»әжЁЎиғҪеҠӣпјҢжңүеҲ©дәҺж„ҹе…ҙи¶ЈеҸҳеҢ–зҡ„зү№еҫҒиЎЁзӨәгҖӮ然иҖҢпјҢз»ҶиҠӮдҝЎжҒҜзҡ„зјәд№ҸеҸҜиғҪеҜјиҮҙTransformerж— жі•еҮҶзЎ®е®ҡдҪҚеҸҳеҢ–еҢәеҹҹзҡ„иҫ№з•ҢгҖӮ

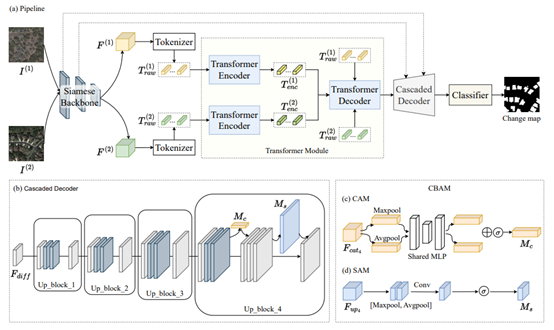

й’ҲеҜ№дёҠиҝ°й—®йўҳпјҢйҷҲеҝ—жіҠж•ҷжҺҲеӣўйҳҹи®ҫи®ЎдәҶз»“еҗҲеҚ·з§ҜзҘһз»ҸзҪ‘з»ңгҖҒTransformerе’ҢжіЁж„ҸеҠӣжңәеҲ¶зҡ„з«ҜеҲ°з«ҜзҪ‘з»ңжЁЎеһӢCTCANetпјҲеӣҫ1пјүиҝӣиЎҢй«ҳеҲҶиҫЁзҺҮйҒҘж„ҹеӣҫеғҸеҸҳеҢ–жЈҖжөӢпјҢеҸ‘иЎЁдәҶеҲ©з”ЁеҚ·з§ҜзҘһз»ҸзҪ‘з»ңе’ҢTransformerе®һзҺ°й«ҳеҲҶиҫЁзҺҮйҒҘж„ҹеӣҫеғҸеҸҳеҢ–жЈҖжөӢзҡ„и®әж–ҮгҖӮдёәдәҶиҺ·еҫ—жҸӯзӨәж„ҹе…ҙи¶ЈеҸҳеҢ–зҡ„й«ҳзә§зү№еҫҒиЎЁзӨәпјҢCTCANetеҲ©з”ЁTokenizerе°ҶеҚ·з§ҜзҪ‘з»ңжҸҗеҸ–зҡ„жҜҸдёӘеӣҫеғҸзҡ„зү№еҫҒеөҢе…ҘеҲ°иҜӯд№үж Үи®°еәҸеҲ—дёӯпјҢ并еҲ©з”ЁTransformerжЁЎеқ—еңЁж Үи®°з©әй—ҙдёӯе»әжЁЎе…ЁеұҖж—¶з©әдёҠдёӢж–ҮгҖӮйҡҸеҗҺпјҢйҮҚжһ„зҡ„еҢ…еҗ«ж·ұеәҰжҠҪиұЎдҝЎжҒҜзҡ„зү№еҫҒиў«дј йҖҒеҲ°зә§иҒ”и§Јз ҒеҷЁпјҢдёҺеҢ…еҗ«жө…з»ҶзІ’еәҰдҝЎжҒҜзҡ„зү№еҫҒиһҚеҗҲгҖӮиҝҷж ·зҡ„иһҚеҗҲдҪҝжЁЎеһӢиғҪеӨҹдҝқжҢҒеҸҳеҢ–еҢәеҹҹзҡ„е®Ңж•ҙжҖ§е№¶еҮҶзЎ®ең°е®ҡдҪҚе°Ҹзӣ®ж ҮгҖӮжӯӨеӨ–пјҢеҚ·з§Ҝеқ—жіЁж„ҸжЁЎеқ—зҡ„йӣҶжҲҗеҸҜд»Ҙе№іж»‘ејӮжһ„зү№еҫҒд№Ӣй—ҙзҡ„иҜӯд№үе·®и·қпјҢ并ејәи°ғйҖҡйҒ“е’Ңз©әй—ҙеҹҹзҡ„зӣёе…іеҸҳеҢ–пјҢд»ҺиҖҢжҸҗй«ҳжЈҖжөӢзҡ„еҮҶзЎ®жҖ§гҖӮеңЁдёӨдёӘеҸҜе…¬ејҖи®ҝй—®зҡ„ж•°жҚ®йӣҶLEVIR-CDе’ҢSYSU-CDдёҠзҡ„е®һйӘҢз»“жһңиҜҒжҳҺпјҢжүҖжҸҗеҮәзҡ„CTCANetжҖ§иғҪи¶…иҝҮдәҶиҝ‘жңҹжңҖе…Ҳиҝӣзҡ„ж–№жі•гҖӮ

еӣҫ1 CTCANetзҪ‘з»ңз»“жһ„еӣҫ

дёҠиҝ°и®әж–Ү第дёҖдҪңиҖ…дёәдҝЎжҒҜеӯҰйҷў2021зә§зЎ•еЈ«з ”究з”ҹе°№жңҰжңҰпјҢйҖҡи®ҜдҪңиҖ…дёәйҷҲеҝ—жіҠж•ҷжҺҲпјҢеҢ—дә¬жһ—дёҡеӨ§еӯҰдёәе”ҜдёҖе®ҢжҲҗеҚ•дҪҚгҖӮиҜҘз ”з©¶еҸ—еҲ°еӣҪ家жһ—дёҡиҚүеҺҹеұҖйЎ№зӣ®вҖңжһ—иҚү科жҠҖжҺЁе№ҝAPPдҝЎжҒҜжңҚеҠЎвҖқпјҲ2021133108пјүзҡ„иө„еҠ©гҖӮ

и®әж–Үй“ҫжҺҘпјҡhttps://www.mdpi.com/2072-4292/15/9/2406